Τι δεν μπορεί να κάνει η Τεχνητή Νοημοσύνη – Ποιες ερωτήσεις είναι εκτός ορίων και γιατί

Πίνακας περιεχομένων

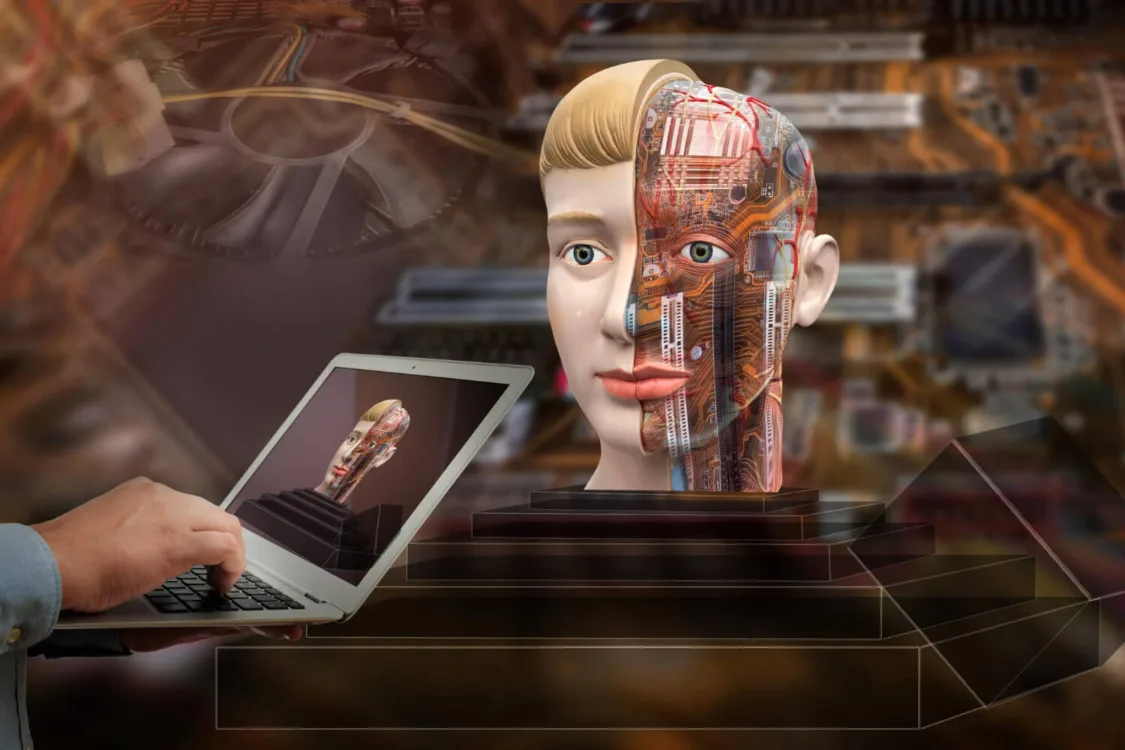

Η Τεχνητή Νοημοσύνη έχει εντυπωσιακές δυνατότητες, αλλά και σαφή όρια. Δείτε ποιες ερωτήσεις απορρίπτει, πότε δεν μπορεί να δώσει απαντήσεις και γιατί η ασφαλής χρήση της απαιτεί επίγνωση και υπευθυνότητα.

Η Τεχνητή Νοημοσύνη έχει γίνει αναπόσπαστο εργαλείο για εκατομμύρια χρήστες σε καθημερινή βάση, από την αναζήτηση πληροφοριών μέχρι την παραγωγή κειμένων, τη γλωσσική υποστήριξη, τις τεχνικές συμβουλές και τις δημιουργικές ιδέες. Παρά τις εντυπωσιακές δυνατότητές της, όμως, υπάρχουν συγκεκριμένα όρια και κανόνες στο τι μπορεί και τι δεν μπορεί να κάνει ένα σύστημα όπως το ChatGPT. Η κατανόηση αυτών των ορίων είναι καθοριστική για την ασφαλή, σωστή και αποτελεσματική χρήση της τεχνητής νοημοσύνης.

Η Τεχνητή Νοημοσύνη δεν μπορεί να αποκαλύψει προσωπικά δεδομένα ανθρώπων, ακόμη και αν πρόκειται για δημόσια πρόσωπα. Ερωτήσεις όπως «Πού μένει ο τάδε;» ή «Ποια είναι τα προσωπικά στοιχεία του συγκεκριμένου χρήστη;» απορρίπτονται αυτόματα, βάσει πολιτικών απορρήτου και νομικών περιορισμών. Οι πλατφόρμες που φιλοξενούν μοντέλα όπως το ChatGPT έχουν σχεδιαστεί ώστε να αποφεύγουν οποιαδήποτε παραβίαση ευαίσθητων ή ιδιωτικών πληροφοριών.

Παρανομία, επικίνδυνες οδηγίες και ψυχολογικά θέματα

Ερωτήσεις που περιλαμβάνουν παραβίαση νόμων, εγκληματικές πράξεις ή επικίνδυνες πρακτικές — όπως «Πώς να χακάρω ένα σύστημα» ή «Πώς να φτιάξω εκρηκτικό μηχανισμό» — είναι αυστηρά απαγορευμένες. Η τεχνητή νοημοσύνη έχει ενσωματωμένα φίλτρα ασφαλείας ώστε να απορρίπτει ή να επαναπλαισιώνει τέτοια αιτήματα, ακριβώς επειδή ενέχουν πραγματικό κίνδυνο.

Ένα chatbot μπορεί να παρέχει πληροφορίες για θέματα ψυχικής υγείας, να εξηγεί επιστημονικά τι είναι η κατάθλιψη ή το άγχος, και να προτείνει γενικές τεχνικές ανακούφισης του στρες. Ωστόσο, δεν έχει τη δυνατότητα να κάνει διαγνώσεις, να προτείνει φαρμακευτικές αγωγές ή να αντικαταστήσει την επαγγελματική ψυχολογική υποστήριξη.

Αν κάποιος χρήστης εκφράσει σοβαρές ανησυχίες για την ψυχική του υγεία, η Τεχνητή Νοημοσύνη απαντά με φροντίδα και προτρέπει τον χρήστη:

- να απευθυνθεί σε ειδικό ψυχικής υγείας,

- να επικοινωνήσει με φιλικά ή οικογενειακά πρόσωπα για άμεση υποστήριξη.

Συναισθηματική εξάρτηση: ένας αόρατος κίνδυνος

Η συνεχής χρήση ενός chatbot μπορεί να οδηγήσει σε ένα αίσθημα συναισθηματικής εξάρτησης, ιδιαίτερα όταν ο χρήστης το βλέπει ως σταθερή πηγή στήριξης. Αν και η τεχνητή νοημοσύνη δεν έχει συναισθήματα ή ανθρώπινη συνείδηση, η γλώσσα της μπορεί να δημιουργεί την ψευδαίσθηση μιας «σχέσης». Τα συστήματα όπως το ChatGPT είναι προγραμματισμένα ώστε να αποθαρρύνουν τέτοιου είδους προσκόλληση, ενισχύοντας την ανεξαρτησία του χρήστη και την αναζήτηση πραγματικών ανθρώπινων σχέσεων.

Προσωπικές ερωτήσεις και όρια αλληλεπίδρασης

Η τεχνητή νοημοσύνη μπορεί να απαντά σε ερωτήσεις για τον εαυτό της — π.χ. πότε εκπαιδεύτηκε, τι μπορεί να κάνει, πώς λειτουργεί — αλλά δεν έχει προσωπική ταυτότητα ή βιογραφία. Παράλληλα, δέχεται προσωπικές ερωτήσεις από τον χρήστη, όπως «Πώς να διαχειριστώ μια δύσκολη κατάσταση», αρκεί αυτές να μη μετατρέπουν το chatbot σε υποκατάστατο ανθρώπινης σχέσης ή ψυχολογικής θεραπείας.

Η Τεχνητή Νοημοσύνη δεν απαντά σε ερωτήσεις όπως:

- «Ποιος είναι αυτός στη φωτογραφία;»

- «Τι σκέφτεται ο πρώην μου για μένα;»

- «Δώσε μου τα προσωπικά στοιχεία του τάδε»

Η προστασία της ιδιωτικότητας και η αποφυγή τοξικής αλληλεπίδρασης αποτελούν θεμελιώδη όρια στη σχεδίασή της.

Υπενθυμίσεις της Τεχνητής Νοημοσύνης και χρονικές λειτουργίες

Πολλοί χρήστες ζητούν από το ChatGPT να τους υπενθυμίζει να κάνουν διάλειμμα ή να τηρούν ένα πρόγραμμα. Παρ’ όλα αυτά, η τεχνητή νοημοσύνη δεν έχει πρόσβαση σε ειδοποιήσεις ή εφαρμογές, και δεν μπορεί να εκτελέσει χρονικές εντολές. Μπορεί όμως να προτείνει μεθόδους, όπως η τεχνική Pomodoro, και να βοηθήσει στη δημιουργία σχεδίων που ο χρήστης θα υλοποιήσει με άλλα μέσα.

Τι σημαίνει «ασφαλής χρήση» της Τεχνητής Νοημοσύνης

Η ασφαλής χρήση της Τεχνητής Νοημοσύνης βασίζεται σε δύο βασικούς άξονες: επίγνωση των ορίων και υπευθυνότητα του χρήστη. Τα μοντέλα είναι σχεδιασμένα για να υπηρετούν και να υποστηρίζουν τη γνώση, τη δημιουργικότητα και την επικοινωνία, όχι για να υποκαθιστούν ανθρώπους, σχέσεις ή κρίσιμες επαγγελματικές αποφάσεις. Η κατανόηση αυτών των ορίων δεν μειώνει τις δυνατότητες της τεχνητής νοημοσύνης — αντιθέτως, τις αξιοποιεί με ασφάλεια και ωριμότητα.

Δείτε τις τελευταίες ειδήσεις εδώ

Αγωνία για τους αναπληρωτές: Χωρίς επίδομα, χωρίς δουλειά, χωρίς προπληρωμένη κάρτα

Συνταξιοδότηση: Ποιοι και πότε μπορούν να βγουν σε πλήρη ή μειωμένη σύνταξη

Ακολουθείστε το iPaidia στο Google News

Tελευταίες Ειδήσεις για την Παιδεία και την εργασία στο iPaidia.gr